Vous soupçonnez une image d’être trop parfaite pour être vraie ? Google vient de dégainer son nouvel outil magique pour percer ou repérer le secret des images IA en un clin d’œil ! Finies les interrogations sans fin devant un selfie suspect ou un paysage trop flamboyant.

Découvrez comment traquer les pixels trompeurs en trois clics seulement. Une chasse aux deepfasks qui promet de devenir votre nouveau superpouvoir numérique !

Le Règne troublant des deepfakes des PDG

La semaine dernière, des images virales montrant Elon Musk et d’autres PDG de la tech dans des appartements miteux ou des parkings de McDonald’s ont inondé les réseaux sociaux. Ces clichés, trop banals pour être vrais, auraient dû éveiller les soupçons. Pourtant, leur réalisme a suffi à tromper des millions d’internautes. Heureusement, Google vient de déployer une arme secrète accessible à tous pour distinguer le réel du virtuel.

Les détecteurs IA traditionnels : une fausse sécurité

Contrairement à une idée reçue, la plupart des détecteurs d’images IA disponibles en ligne sont notoirement peu fiables. Interroger Grok sur X pour savoir si une photo est générée par IA relève souvent du pari hasardeux, l’assistant fournissant régulièrement des réponses erronées, parfois même comiques. Cette imprécision chronique a longtemps laissé les utilisateurs démunis face à la prolifération des deepfakes.

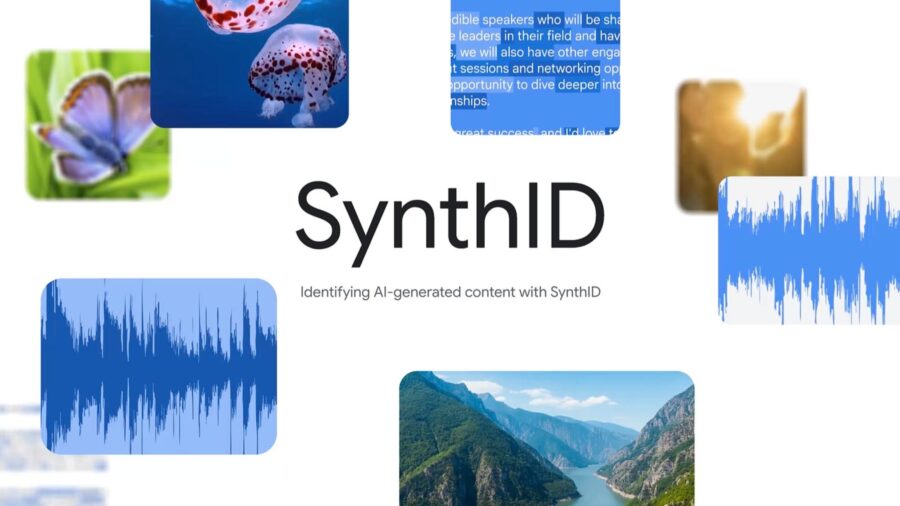

SynthID : la révolution invisible de Google

Google avait pourtant développé il y a deux ans une solution ingénieuse : le watermark SynthID, une signature numérique invisible intégrée directement dans les pixels de chaque image créée avec ses outils IA. Jusqu’à récemment, cette technologie restait inaccessible au grand public. Le changement est intervenu il y a quelques jours seulement, transformant Gemini en détective anti-deepfake.

Gemini devient votre expert anti-tricherie

Le processus est désormais d’une simplicité déconcertante. Il suffit d’uploader une image suspecte dans Gemini et de poser la question magique : « Cette image a-t-elle été créée avec l’IA Google ? ». L’assistant analyse alors la présence du watermark SynthID et utilise son raisonnement pour fournir une réponse contextuelle. Une fonctionnalité qui tombe à pic alors que Nano Banana Pro, le nouveau générateur d’images de Google, produit des résultats hyper-réalistes.

Le cas d’école des PDG dans un parking

Les images de Musk et consorts constituent l’exemple parfait. Celle montrant les sept magnats de la tech entassés dans un modeste appartement a cumulé près de 9 millions de vues sur X avant d’essaimer sur Bluesky. D’autres variantes les montraient dans un parking, Musk fumant le cigare, ou attablés au McDonald’s près d’un Cybertruck. Gemini confirme que tous ces clichés portent la signature SynthID.

Limites et bon sens : le duo gagnant

L’outil n’est pas infaillible : il ne peut identifier avec certitude les images générées par des IA concurrentes. Cependant, quand Gemini détecte le watermark SynthID, la supercherie est confirmée. Reste que le bon sens demeure un allié précieux : imaginer Musk et Altman partageant un repas dans un parking, après leurs conflits publics, relève du fantasme.

L’ère nouvelle de la vérification numérique

Si les fakes continuent de circuler, Google offre enfin aux utilisateurs lambdas un premier rempart contre la désinformation visuelle. À l’heure où la frontière entre réel et artificiel s’estompe, cette capacité à vérifier l’authenticité des images représente un pas crucial vers une navigation éclairée sur le web. L’ère du « je crois ce que je vois » est révolue, place à l’ère de la vérification proactive.

- Partager l'article :